Ludilo oko ChatGPT-a ne smiruje se mjesecima. Studenti ga masovno koriste za akademske obveze, dugi repetitivni poslovi pisanja, prevođenja i računanja se rješavaju u 10-ak sekundi. No koliko je ChatGPT pouzdan i može li napraviti više štete nego koristi? Puno je manje koristan nego što mislimo, i da, definitivno može napraviti štetu. Kako u akademskoj zajednici tako i u drugim sferama društva.

Krajem prošle godine, točnije 30.11.2022. dogodilo se nešto što je promijenilo način kako radimo, studiramo i stvaramo. Ažuriran je OpenAI chatbot za “pola koraka” na zadnju verziju 3.5 te je preplavio sve portale i društvene mreže … i to s razlogom, jer za razliku od onih chatbota koje koriste neke tech tvrtke za svoj customer support, a koji ne bi zadovoljio niti Beroševe standarde za IT i cvjećarske usluge, ovaj AI sugovornik zaista tipka kao ljudsko biće. Svatko tko je spojen na internet vjerojatno zna o čemu pričam. Čašice razgovora s ChatGPT chatbotom bi se po kreativnosti, rječitosti i humoru posramio svaki Tinder razgovor.

Tehnološka pozadina ChatGPT-a

ChatGPT je rađen na NLP principu (Natural language processing) koristeći arhitekturu neuralnih mreža koju je chat koristio za učenje bez supervizije čovjeka na golemoj bazi podataka – internetu. Postao je megapopularan u zadnjih 6 mjeseci otkad je izbačena GPT-3.5 verzija, to je prvi chat baziran na umjetnoj inteligenciji koji je dostupan širokoj javnosti na korištenje, a da je istovremeno toliko moćan.

GPT je treniran na ogromnoj bazi web stranica i društvenih mreža. Osim nevjerojatno uvjerljivog razgovora kao da je čovjek i odgovaranja na golem spektar pitanja, čak može prepoznati i oponašati subkulture razgovora (npr. tip razgovra i komentara kakvi su specifični za Reddit). Model je treniran do kraja 2021. godine, te nakon toga nema pristup podatcima na internetu.

Što sve radi ChatGPT?

Može ti u 10-15 sekundi napisati esej, rješavati razne zadatke (kemija, fizika, biologija – samo mu napiši uputu što želiš da ti riješi), odgovarati na pitanja iz svih područja interesa. Čak štoviše Google se zabrinuo da će ih ChatGPT (odnosno firma koja ga je napravila zove se OpenAI) zamijeniti i odmah nedugo nakon releasa ChatGPT-a je Goolge najavio svoj vlastiti AI Chat model koji se zove Bard.

Jer umjesto da googlamo i čitamo tekstove na 10 različitih web stranica da bismo donijeli zaključak, ovako samo možemo pitat ChatGPT i on nam sumira svih 10 najrelevantijih stranica (i puno više) u nekoliko rečenica da nam odgovori koncizno i točno. Uštedili smo si vrijeme 15-30 minuta, ako ne i puno puno više ako smo željeli pričitati neki research paper. Odgovor smo dobili u 10 sekundi koliko mu je trebalo da napiše najrelevantnije informacije.

Piše pjesme, prevodi savršeno, priča na bilo kojem jeziku poput pravog čovjeka i apsolutno sve zna, pa čak i programira. Dovoljno mu je samo reći što želiš i u kojem programskom jeziku, i on će ti to napisati u kodu.

Zvuči kao savršen alat za studente, što i je – ako ga znaju koristiti na ispravan način. Vidim na Redditu koliko ga studenti hvale i koliko su oduševljeni sa Chat GPT-om.

ChatGPT – verzija 4

Ono što je posljednjih dana u fokusu javnosti je ChatGPT verzija 4. Naime četvorka je trenutno dostupna u testiranju samo određenim developerima i internim testerima. U medije je već počelo curiti kako je GPT-4 daleko napredniji, precizniji, može izvlačiti informacije iz slika i generalno je jednako velika stepenica iznad GPT-3, koliko je GPT-3 naspram prethodnih (za koje većina ljudi nikad nije ni čula jer su bili bezveze).

Prije nekoliko dana je Microsoft priznao da već neko vrijeme GPT-4 odgovara u pozadini njihovog Bing chata, tako da tamo ga možete isprobati (iako doduše nema tih cool stvari poput dodavanja slika), ali osobno priznajem da se osjeti razlika.

Tamna strana ChatGPT-a

Odgovori koje ChatGPT natipka zvuče super ljudski, super realno i nerijetko super dovitljivo, ali tko god je popričao s njime s malo zdrave skepse (i nedajbože provjerio koliko je točno ovo u što ChatGPT govori) shvatio je vjerojatno da s druge strane sjedi algoritam koji se jako trudi zvučati točno, ali kojeg baš boli briga je li ovo što tvrdi zaista istina.

Primjerice, ChatGPT može napisati zgodan Introduction za paper, ali informacije i reference će nerijetko izmisliti, ili će ih bar krivo protumačiti. Ako zapneš u pisanju koda, AI frend će ti rado priskočiti u pomoć, ali nema garancije da kod koji ti ponudi, i koji možda na prvu izgleda da bi mogao raditi, nije potpuna glupost. Ovo zadnje živopisno opisuje upozorenje i ban ChatGPT-a koje zadnja 3 mjeseca stoji na stranici StackOverflow, stranici gdje programeri traže pomoć kada zapnu u svom poslu pa pitaju druge kolege developere da im daju snippet koda koji bi im mogao riješiti problem.

Naravno, puno puta će dati točan kod, ili dati točnu informaciju što ga se pita, naročito ako mu se dobro objasni što želiš da ti napravi ili objasni.

Ali tu dolazimo do zeznutog dijela, a to je ako sam korisnik već ne zna odgovor na pitanje ili napisati kod, ne može se pouzdati u njega. Jer sam OpenAI (firma koja ga je napravila) mu je zadao da ukoliko ne zna odgovor na određeno pitanje, popunit će to nekom laži. Jer ChatGPT je napravljen da primarno zvuči kao čovjek, a ne da bude točan

Na kraju krajeva, i da je napravljen da primarno govori istinu, opet koliko je ta istina točna? Jer ne postoji univerzalna baza ljudskog znanja. Ono se mijenja (a naročito u medicini i znanosti) iz dana u dan te ChatGPT ne može niti uzeti neko “najtočnije” i verificirano znanje jer ono ne postoji. Čak i kada mu se da znanstveni rad da pročita i napravi sažetak toga što je pročitao, opet će često izmisliti nešto i ubaciti nepostojeće informacije jer će nešto krivo protumačiti. Ili će one bitne informacije zanemariti.

Osobno sam se nebrojeno puta uvjerio kako me ChatGPT uvjerava u nešto za što znam da nije istina, ali to zvuči tako uvjerljivo i točno. I to nije samo problem akademske zajednice i studenata koji ga koriste za svoje obaveze. To je problem koji ulazi u društvo, jer ako smo se zgražali kako si ljudi dijagnosticiraju tumore, Lupus i Chronovu bolest guglajući simptome kad imaju blage grčeve u crijevima, sada će te dijagnoze postati X puta ozbiljnije i još više će običan građanin biti uvjeren u svoju bolest. Jer to više nije pročitao na Googlu, nego mu je to rekao netko tko zvuči kao čovjek, čak štoviše liječnik. Umjetna inteligencija koju mediji svakodnevno hvale u superlativima kao svomoguću u svim područjima, kako onda ne vjerovati toj umjetnoj inteligenciji?

Primjer kako ChatGPT griješi

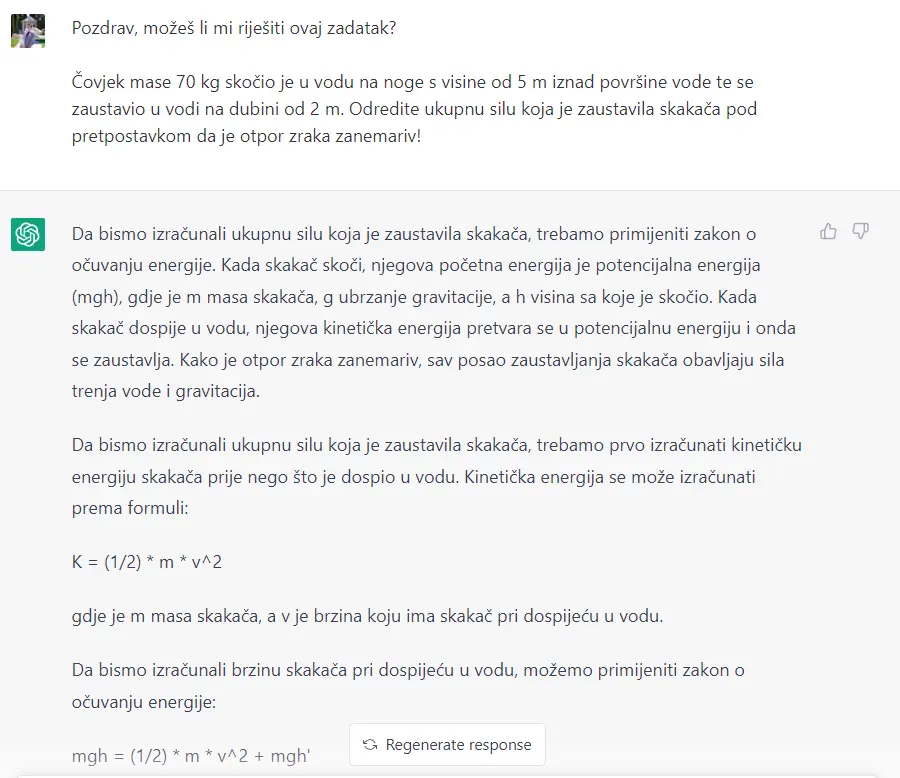

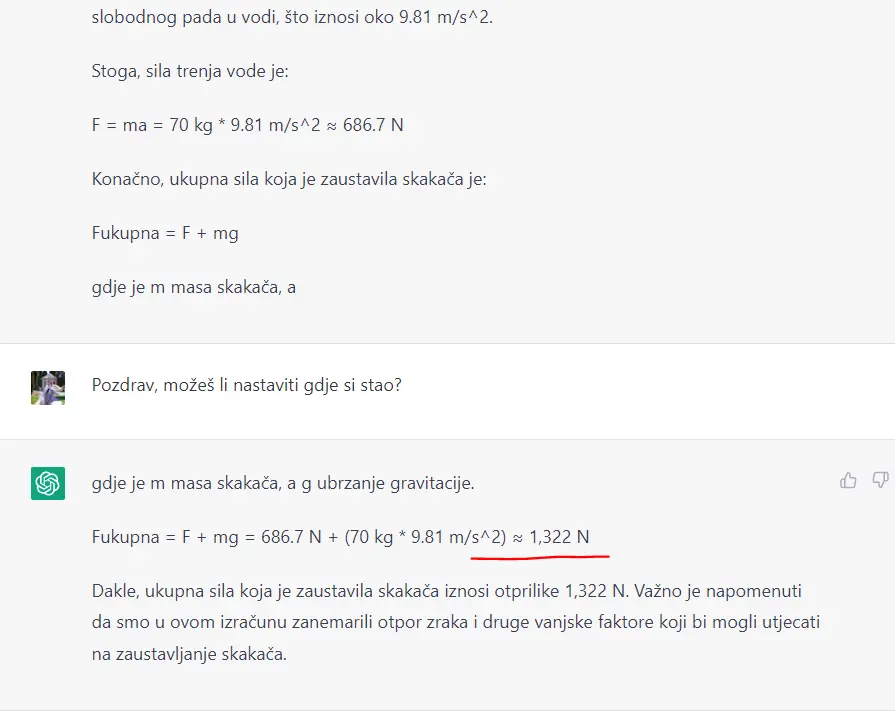

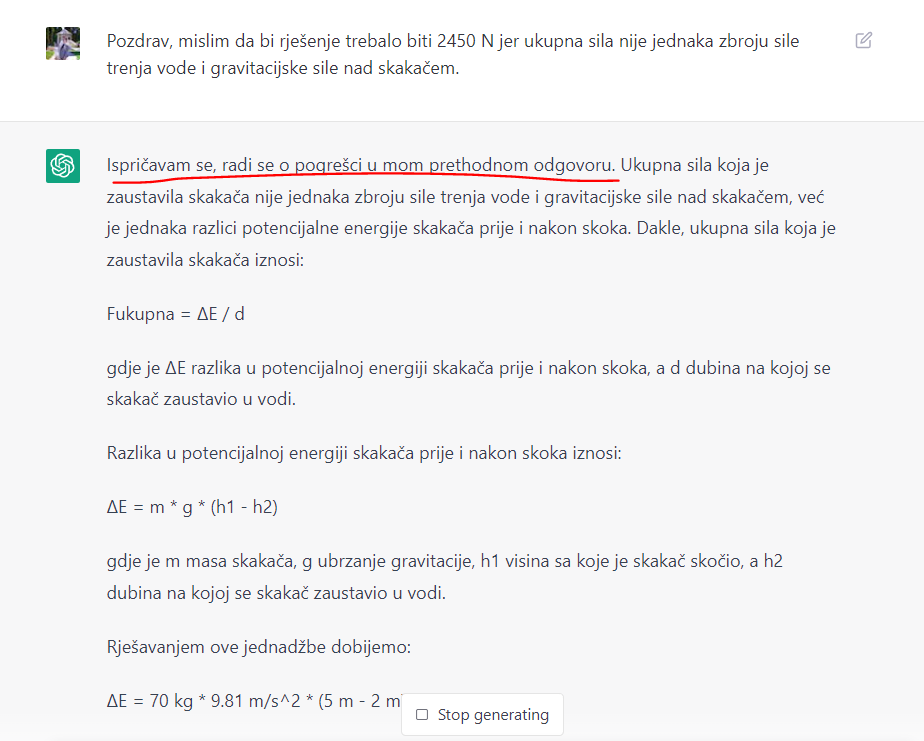

Ovdje smo postavili Chat GPT-u jedno pitanje iz fizike sa prijemnog na Medicinski fakultet u Zagrebu.

Njegov krajnji odgovor bio je da je ukupna sila ≈ 1,322 N, što je krivo!

Ovdje je ChatGPT krenuo sa krivom pretpostavkom da je ukupna sila jednaka zbroju sile trenja vode i gravitacijske sile nad skakačem, a to nije istina.

To je opasno, jako opasno za korištenje na fakultetima jer ChatGPT je ponavljam, programiran da zvuči kao čovjek, a NE da daje točne informacije. Kada mora odabrati između toga da zvuči dobro ili kaže nešto točno, gotovo uvijek će odabrati da zvuči uvjerljivo, tako je programiran. A jednako vrijedi i za GPT-4, i vjerojatno još puno verzija nakon njega.

Zaključno

ChatGPT je odličan alat koji može drastično smanjiti neki repetitivni posao, prevoditi, pisati, čak i programirati, davati kreativne ideje i puno toga. Ali treba ga se koristiti s oprezom, naročito u akademske svrhe. Jer ako student ne zna da je ChatGPT nešto krivo rekao ili preveo, na kraju će imati lošiji rezultat za svoj seminar, research ili neku drugu akademsku obavezu nego da je cijeli proces sam radio. A to je još i najmanja briga, što sve može krenuti po zlu ako se znanost, studenti, radnici pa na kraju i obični ljudi za privatne potrebe previše pouzdaju i vjeruju ChatGPTu – svim verzijama.

EduHub

Istina,

vrlo lepo napisano i upravo tako jeste..

Samo oprezno.